Требования

- опыт работы в качестве инженера данных от 3 лет;

- промышленный опыт PySpark, Clickhouse (или без него, но с хорошим опытом Greenplum );

- богатый опыт работы с Airflow, NiFi или др. оркестраторами ETL процессов;

- уверенное владение SQL и использование его в работе, уровень выше среднего;

- уверенное знание Python (в т.ч. pandas), выше среднего;

- знание основ ООП, теории алгоритмов, структур данных;

- знание теории построения хранилищ данных;

- любознательность, широкий кругозор, желание изучать новые технологии, исследовательский склад ума;

- Важны софты, чтоб клещами не вытягивать ответы;

- Погружение в инфраструктуру для обеспечения работы кластера (железо его настройка, методы обработки хранимого массива данных);

- Hadoop и Spark - нужно знать инфраструктуру, т.к. идет переход с Hive на Spark.

Будет плюсом

- опыт в Unix shell: базовые команды для работы с файлами и процессами;

- опыт работы с брокерами сообщений;

- опыт работы с Docker, Kubernetes;

- опыт работы с Big Data стеком, Spark, Hive;

- опыт работы с данными по логам.

Обязанности

- участие в разработке ядра системы анализа процессов;

- разработка переиспользуемых трансформаций данных и пайплайнов;

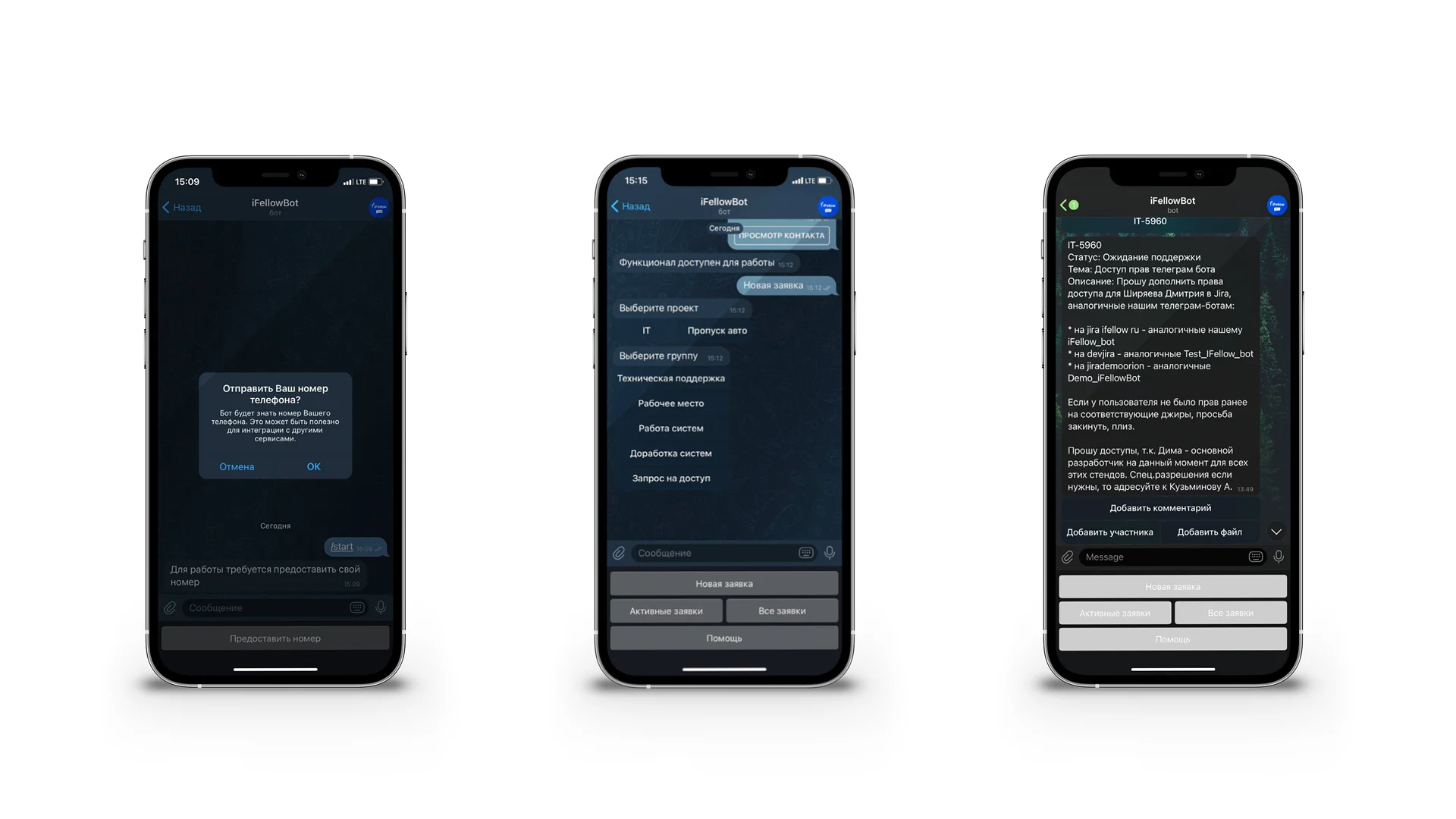

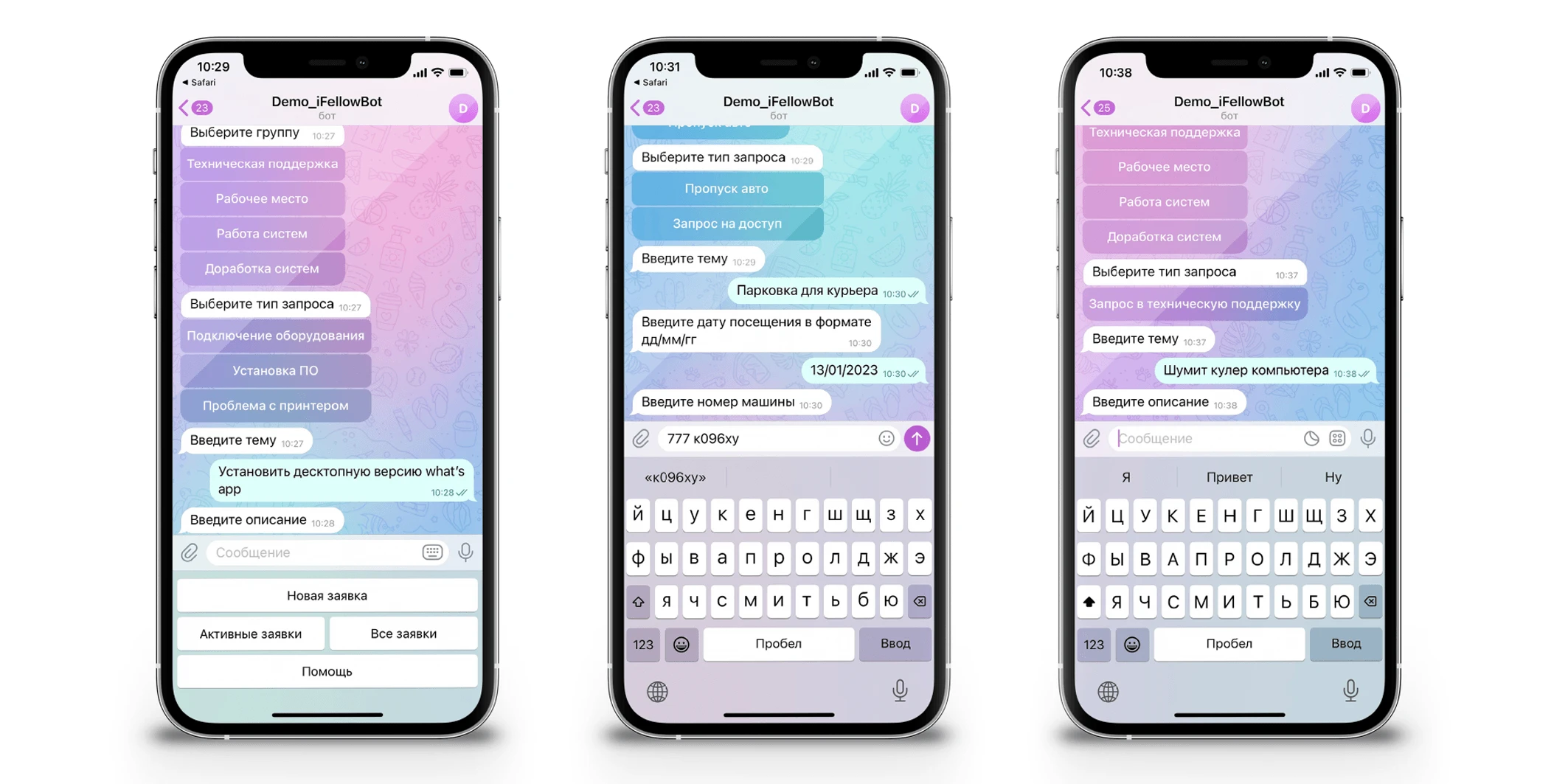

- разработка self-service инструментов обработки данных для пользователей;

- разработка и проектирование модели данных.

Похожие вакансии

Тестировщик ЦФТ

- Тестирование

Дата публикации:

26.02.2026

Инженер нагрузочного тестирования, мидл

- Тестирование

Дата публикации:

26.02.2026

Senior/Middle react разработчик

- Разработка

- TypeScript

Дата публикации:

22.12.2025

Опыт работы

от 3 лет

Key account manager (сервисные проекты)

Дата публикации:

22.12.2025

Опыт работы

от 3х лет

Sales manager

- Продажи

Дата публикации:

22.12.2025

Опыт работы

от 4 лет

Отклик на вакансию

Выбранное направление:

Разработка

Медиацентр

Смотреть все

Старт 29.06.2023

Орион

Цифровой проектный офис: критический путь PMO